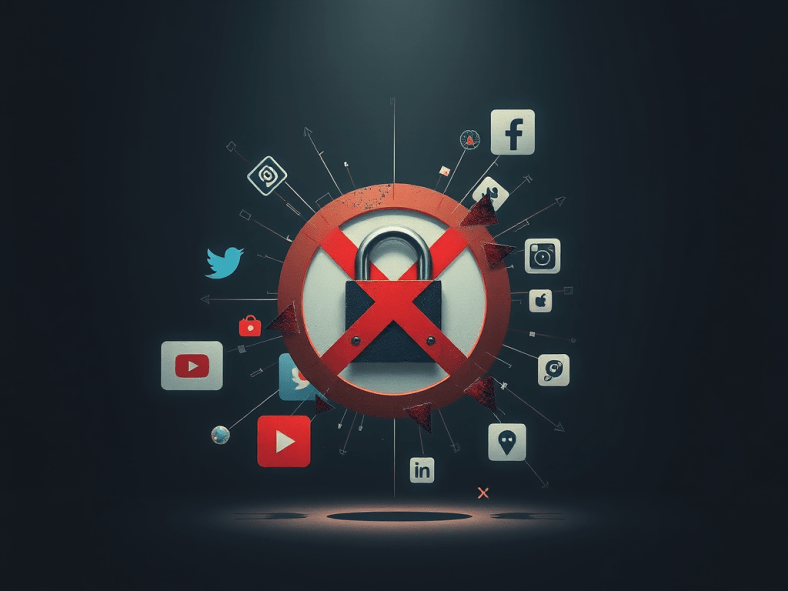

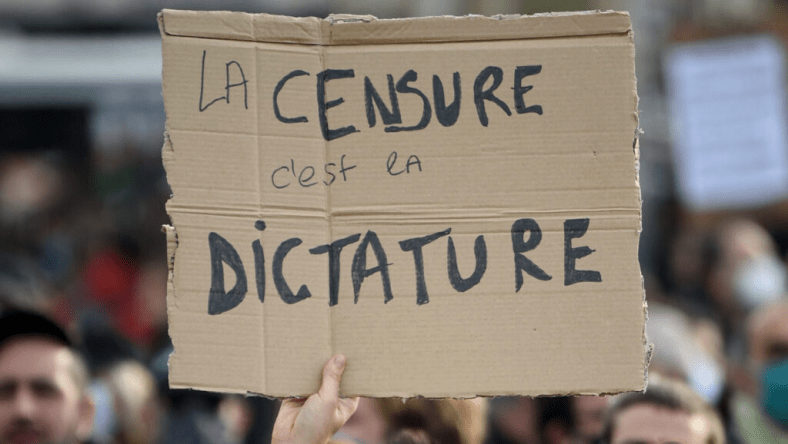

La promesse de Bluesky d’un havre de paix sans censure s’effondre alors que les utilisateurs en Turquie se bousculent pour un accès non censuré via des applications tierces.

Bluesky, la plateforme sociale autrefois censée être un sanctuaire pour la liberté d’expression , a commencé à se plier aux exigences du gouvernement. Malgré une faille qui permet encore à certains utilisateurs de passer entre les mailles du filet, la décision du réseau de censurer à la demande des autorités turques a suscité des inquiétudes quant à la capacité de sa fondation à lutter contre la censure comme elle l’avait promis.

Un rapport a récemment révélé que Bluesky avait accepté de restreindre l’accès à 72 comptes en Turquie. Désormais, les utilisateurs du pays sont privés de ces voix. Parmi eux, 59 comptes ont été censurés au nom de la protection de la « sécurité nationale et de l’ordre public », tandis que 13 autres comptes, ainsi qu’au moins une publication, ont été masqués.

Pour une plateforme qui a attiré de nombreux Turcs fuyant la censure excessive d’autres pays, la décision de Bluesky de se plier à la pression du gouvernement turc est perçue comme une trahison. Les utilisateurs se demandent désormais si les promesses d’ouverture de la plateforme ont été sincères.

Le problème vient de l’application officielle de Bluesky, qui propose des paramètres de modération au niveau de l’utilisateur, mais ne permet pas de se soustraire au système de censure centralisé de l’entreprise. Une partie importante de ce système repose sur des étiquetages géographiques, dont un récemment déployé spécifiquement pour la Turquie, qui masque automatiquement le contenu ciblé à l’intérieur du pays.

Si vous utilisez l’application officielle de Bluesky et que l’entreprise décide de bloquer du contenu en fonction de votre localisation, vous êtes bloqué. Il n’existe aucun moyen officiel de consulter les comptes ou publications censurés.

Plus : Les censeurs de l’UE visent Bluesky

Néanmoins, l’architecture sous-jacente de Bluesky offre une échappatoire, du moins pour l’instant. Basé sur le protocole AT, Bluesky prend en charge un réseau d’applications tierces, collectivement appelé Atmosphère, où la modération peut être gérée différemment, voire ignorée.

Étant donné que la censure est appliquée au niveau client via des étiquetteurs géographiques, et que les comptes restreints ne sont pas bannis des serveurs et relais Bluesky, les applications indépendantes peuvent toujours y accéder. Des applications comme Skeets, Ouranos, Deer.social et Skywalker, qui n’ont pas adopté d’étiquetteurs de modération géographique, permettent aux utilisateurs turcs d’accéder au contenu bloqué par l’application officielle.

Cependant, cette solution de contournement est fragile.

La plupart des développeurs tiers n’ont pas volontairement résisté à la censure. L’ajout d’étiquettes géographiques nécessiterait plutôt du codage supplémentaire, et leurs applications passant inaperçues grâce à une base d’utilisateurs plus restreinte, les développeurs voient peu de raisons immédiates de s’y conformer.

Mais si l’une de ces applications devenait suffisamment importante, elle pourrait facilement devenir la cible de pressions gouvernementales, ou risquer d’être retirée des boutiques d’applications comme celle d’Apple si elle refuse d’appliquer les exigences de censure.

Voir l’article original cliquez ci-dessous :