Meredith Whittaker, présidente de l’application de messagerie américaine Signal, a menacé de la retirer de France en raison d’un projet de loi où le gouvernement exige la possibilité de consulter les conversations privées.

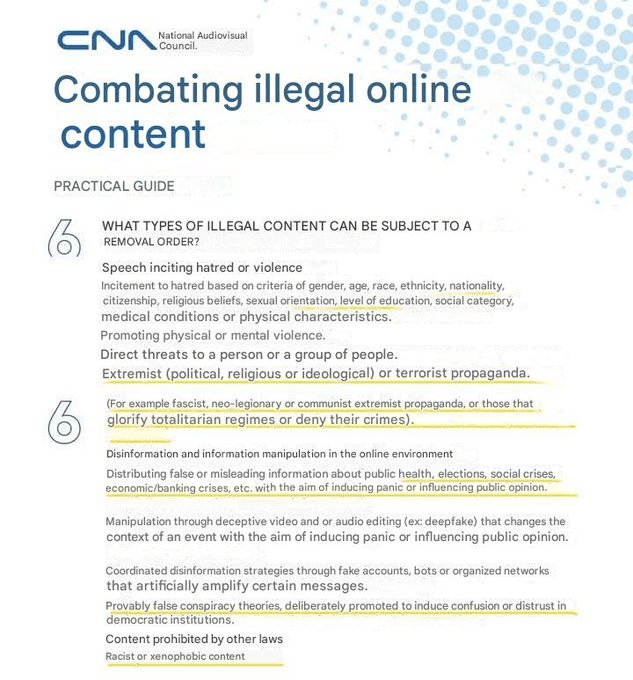

Dans l’article 8 du projet de loi « Sortir la France du piège du narcotrafic » , la France a déclaré qu’elle souhaitait que les applications de messagerie cryptées telles que Signal et WhatsApp et les services de messagerie électronique cryptés tels que Proton Mail fournissent aux autorités les données décryptées de leurs utilisateurs dans les 72 heures suivant la demande.

Cette mesure a suscité une opposition importante de la part des défenseurs de la vie privée, des entreprises technologiques et des experts en cybersécurité en raison de ce qu’ils considèrent comme ses implications en termes d’affaiblissement du cryptage et de compromission de la sécurité des utilisateurs à l’échelle mondiale.

Le Sénat français l’avait adopté le 4 mars et il devait être examiné à nouveau à l’Assemblée nationale.

Le 17 mars, le projet de loi a été examiné par la commission législative de l’Assemblée, ce qui a suscité une forte opposition.

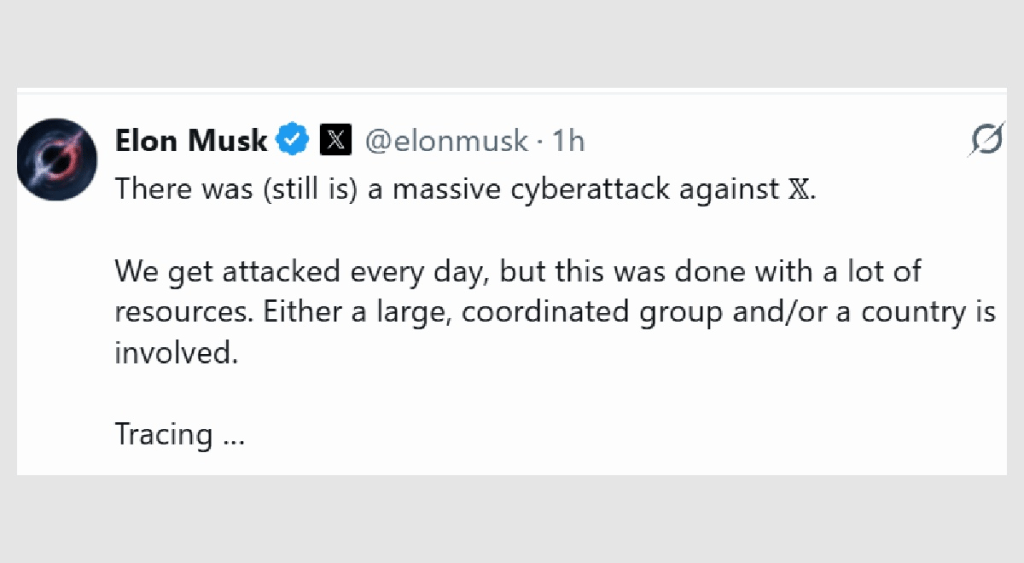

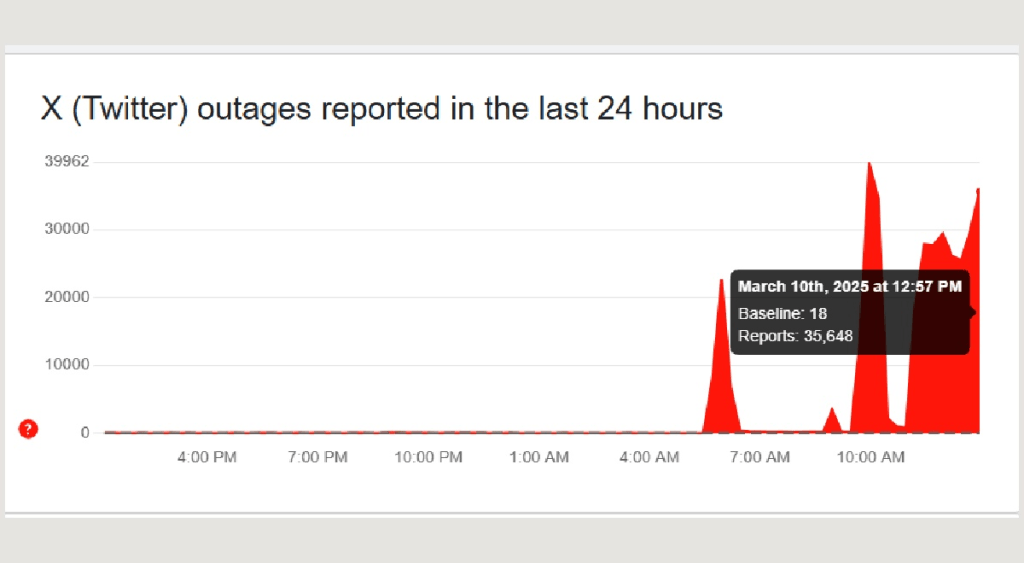

Whittaker a publié un long message sur X le 19 mars, tirant la sonnette d’alarme sur la loi française qui sera bientôt votée.

Elle a condamné cette attaque, la qualifiant d’« attaque malhonnête et insensée », qui contredit le consensus des experts et menace à la fois la cybersécurité mondiale et le droit fondamental à la vie privée.

« La loi française sur le trafic de stupéfiants obligerait les fournisseurs de communications cryptées, comme Signal, à créer une porte dérobée permettant au gouvernement de s’inscrire à n’importe quel groupe ou chat de son choix. Au nom de la lutte contre le trafic de drogue », a déclaré Whittaker.

« Alors que ceux qui font la promotion de cette mauvaise loi se sont empressés d’assurer aux politiciens français que la proposition ne « brise pas le cryptage », leurs arguments sont aussi ennuyeux que périmés [et] ridicules. »

Elle a souligné que « le chiffrement de bout en bout ne doit comporter que deux extrémités : l’expéditeur et le(s) destinataire(s). Sinon, il est détourné et toute autre méthode « porte dérobée » « porte ouverte sur la confidentialité des communications ».

Whittaker a noté qu’une tentative similaire de contournement du cryptage avait été empêchée avec succès au Royaume-Uni en 2019 et a souligné que la France devrait également abandonner sa proposition actuelle.

Elle a averti que les solides garanties de confidentialité de Signal étaient menacées, soulignant que pour quiconque souhaitant les saper, « au lieu de se battre avec des mathématiques incassables, il leur suffit de compromettre un employé du gouvernement français ou le logiciel fourni par le fournisseur utilisé pour charger des agents du gouvernement dans vos conversations privées ».

Whittaker a déclaré que Signal quitterait le marché français plutôt que de se conformer à la loi contestée sur la protection de la vie privée.

« En ce moment particulièrement, il y a tout simplement trop de choses qui dépendent de Signal, de notre capacité à forger un avenir dans lequel les communications privées perdurent, pour permettre une telle atteinte pernicieuse », a-t-elle déclaré.

Matthew Hodgeson, PDG d’Element, une plateforme de communication sécurisée utilisée par les gouvernements, a déclaré au média spécialisé Computer Weekly fin février qu’Element craignait que les propositions françaises ne soient « techniquement pas réalisables sans affaiblir fondamentalement la sécurité des services de messagerie et de courrier électronique ».

Matthias Pfau, PDG de Tuta Mail, un fournisseur allemand de messagerie cryptée, a déclaré que la proposition française n’était ni nécessaire ni proportionnelle.

L’association française de défense des droits et libertés numériques La Quadrature du Net a dressé un panorama de la loi française sur le narcotrafic, mettant en évidence ce qu’elle considère comme de nombreux éléments problématiques.

Outre la porte dérobée de cryptage, elle a affirmé que la loi ne s’appliquait pas seulement aux trafiquants de drogue mais pouvait également être utilisée pour surveiller les militants.

Une disposition de la loi classe comme secret tout document détaillant les méthodes utilisées pour les techniques de surveillance au cours des enquêtes.

Cela porte atteinte au droit à une défense adéquate et empêche le public de comprendre toute l’étendue des capacités de surveillance de la police judiciaire, a déclaré le groupe.

La loi permet également à la police d’activer à distance les microphones et les caméras des appareils fixes et mobiles connectés – ordinateurs, téléphones, etc. – pour « espionner » les personnes qui les utilisent.

Les organismes internationaux de défense des droits de l’homme ont reconnu que le cryptage était fondamental pour la vie privée et d’autres droits.

En 2022, le Comité européen de la protection des données et le Contrôleur européen de la protection des données ont déclaré que le chiffrement « contribue de manière fondamentale » à la vie privée, à la liberté d’expression et à la croissance numérique.

La Cour européenne des droits de l’homme a reconnu l’importance de l’anonymat pour la protection de la liberté d’expression et, en février 2024, a jugé que la demande de la Russie concernant les clés de cryptage de Telegram violait les lois sur les droits de l’homme.

Voir l’article original cliquez ci-dessous :

Laisser un commentaire