Le sommet mondial sur l’IA fait progresser la gouvernance soutenue par l’ONU, mais les inquiétudes grandissent concernant les liens avec la censure et la surveillance.

Le Sommet d’action sur l’IA, qui s’est tenu à Paris cette semaine, a réuni 60 signataires soutenant une déclaration sur « une intelligence artificielle inclusive et durable pour les personnes et la planète ».

Parmi les dizaines de pays concernés figurent l’Union européenne et la Commission de l’Union africaine, ainsi que l’Australie, le Brésil, le Canada, la Chine, la France, l’Allemagne – mais pas les États-Unis ni le Royaume-Uni.

La réunion en France a réuni des représentants de gouvernements, d’organisations internationales, de la société civile, d’universitaires, de chercheurs et du secteur privé.

La déclaration s’engage à respecter un certain nombre d’initiatives des Nations Unies, comme les Objectifs de développement durable (ODD), régulièrement critiqués pour avoir favorisé la censure et la surveillance. Parmi les autres initiatives internationales citées figurent la Recommandation de l’UNESCO sur l’éthique de l’IA et un certain nombre de résolutions de l’Assemblée générale des Nations Unies.

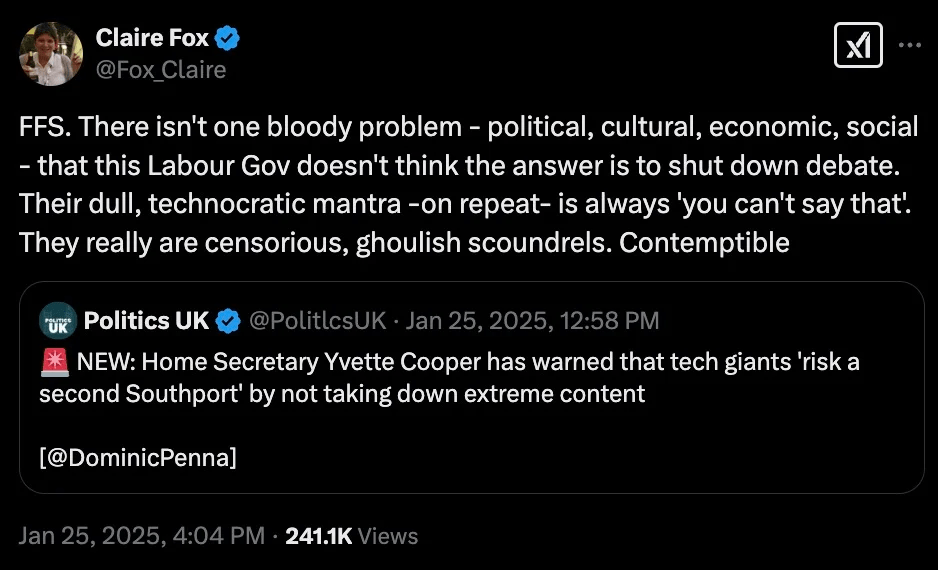

Mais le document signé à Paris évoque le renforcement de la coopération internationale et une gouvernance internationale mieux coordonnée comme principales priorités, tout en s’engageant, de manière inquiétante (étant donné que « l’intégrité de l’information » est souvent utilisée comme un « mot de code » pour la censure) à « continuer à s’attaquer aux risques de l’IA pour l’intégrité de l’information ».

Afin de renforcer le travail conjoint sur les initiatives d’IA « publiques et privées », les partisans de la déclaration ont lancé la Plateforme et l’Incubateur d’IA d’intérêt public.

En ce qui concerne l’approbation des ODD de l’ONU et la manière dont cela peut faire obstacle à la liberté d’expression, il convient de rappeler que cet ensemble de 17 objectifs mondiaux interconnectés favorise non seulement l’identité numérique, mais aussi indirectement la censure de ce que les autorités considèrent comme des « menaces à l’intégrité de l’information » qui peuvent avoir un impact négatif sur les ODD – comme les « discours de haine », la « désinformation », etc.

Une autre initiative de l’ONU mentionnée par la Déclaration de Paris dans le Pacte numérique mondial, dont les signataires ont convenu qu’elle servirait de base au lancement d’un Dialogue mondial sur la gouvernance de l’IA et du Groupe scientifique international indépendant sur l’IA, comme moyen « d’aligner les efforts de gouvernance en cours ».

Le Pacte numérique mondial est l’une des annexes du Pacte pour l’avenir de l’ONU, qui promeut notamment l’identification numérique (via ce que l’ONU, l’UE, le WEF et la Fondation Gates aiment appeler l’infrastructure publique numérique, DPI), ainsi qu’un certain nombre de politiques de censure et de surveillance, liées à la « lutte contre et au traitement » des éléments considérés comme des « discours de haine », de la « mésinformation », de la « désinformation » et de la « cyberintimidation ».

Le Pacte pour l’avenir, tout en affirmant que des mesures de protection de la vie privée sont intégrées, promeut également une plus grande « circulation (partage) de données transfrontalières ».

Voir l’article original cliquez ci-dessous :

Laisser un commentaire