Un activiste canadien devient le visage d’une confrontation sur la liberté d’expression alors que Washington dénonce le contrôle numérique de Canberra.

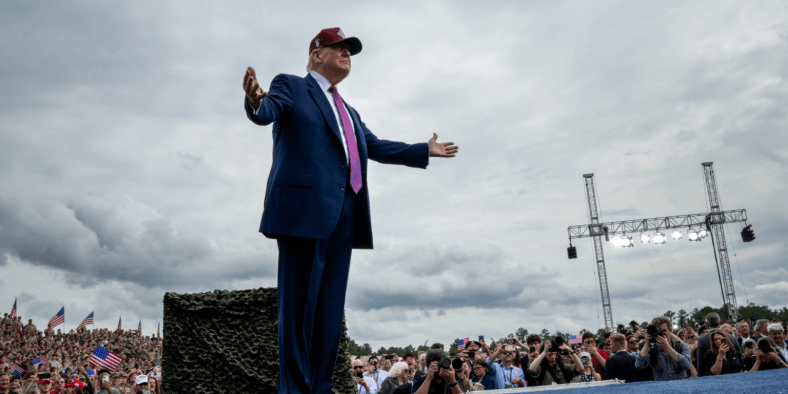

Le Département d’État américain a inclus l’Australie parmi les pays dont les gouvernements sont critiqués pour avoir soumis les plateformes de médias sociaux américaines à des exigences de censure des utilisateurs.

Dans le cas de l’Australie, les exigences reposent sur la promotion de programmes spécifiques basés sur le genre, en particulier les politiques liées aux personnes transgenres.

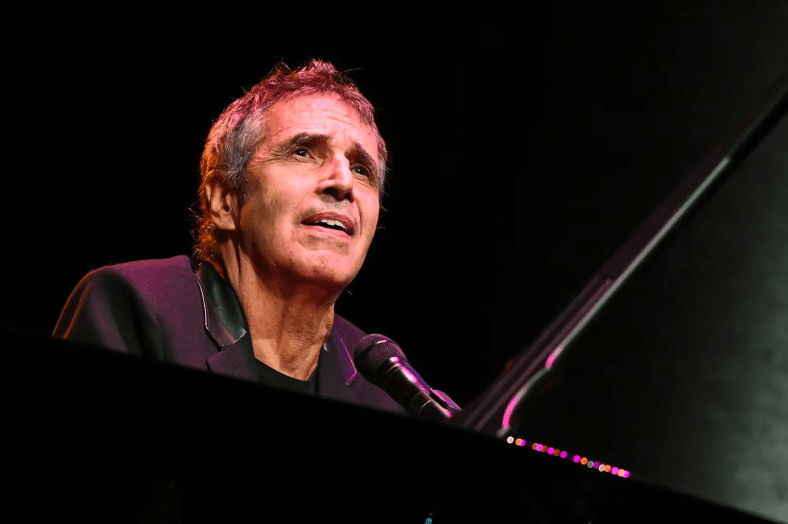

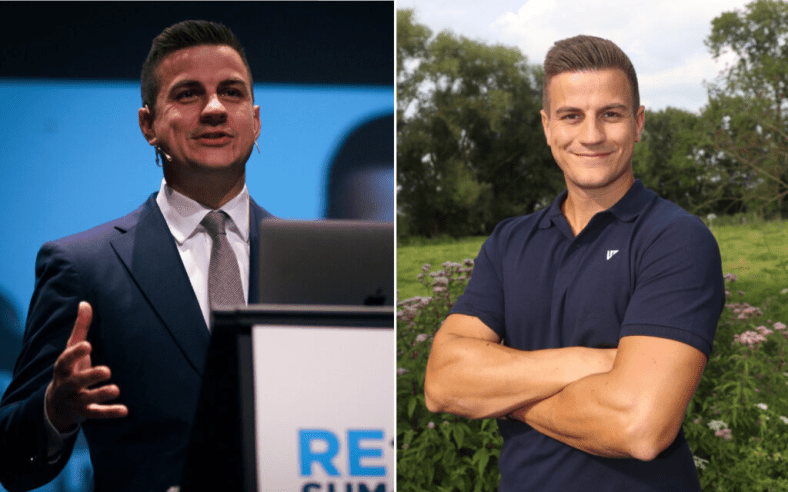

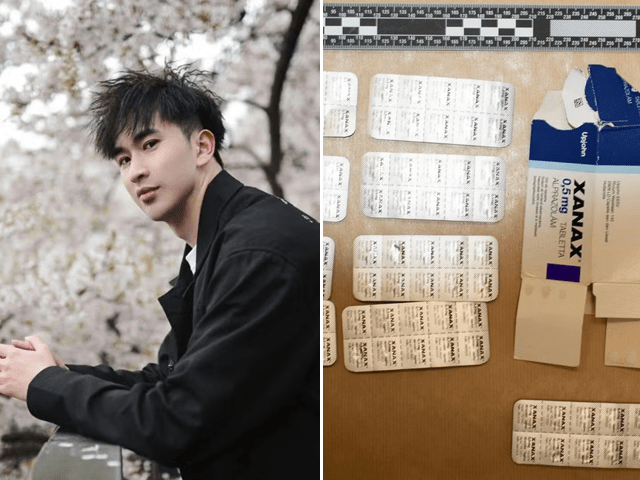

Le Bureau de la démocratie, des droits de l’homme et du travail du Département d’État a utilisé l’exemple d’un Canadien, Chris Elston (« Billboard Chris »), qui fait campagne contre le fait de soumettre les enfants à des bloqueurs de puberté, arguant qu’ils sont trop jeunes pour donner un consentement significatif à de telles procédures qui changent la vie.

« Le plus grand scandale de maltraitance d’enfants au monde actuellement », c’est ainsi qu’Elston décrit la situation.

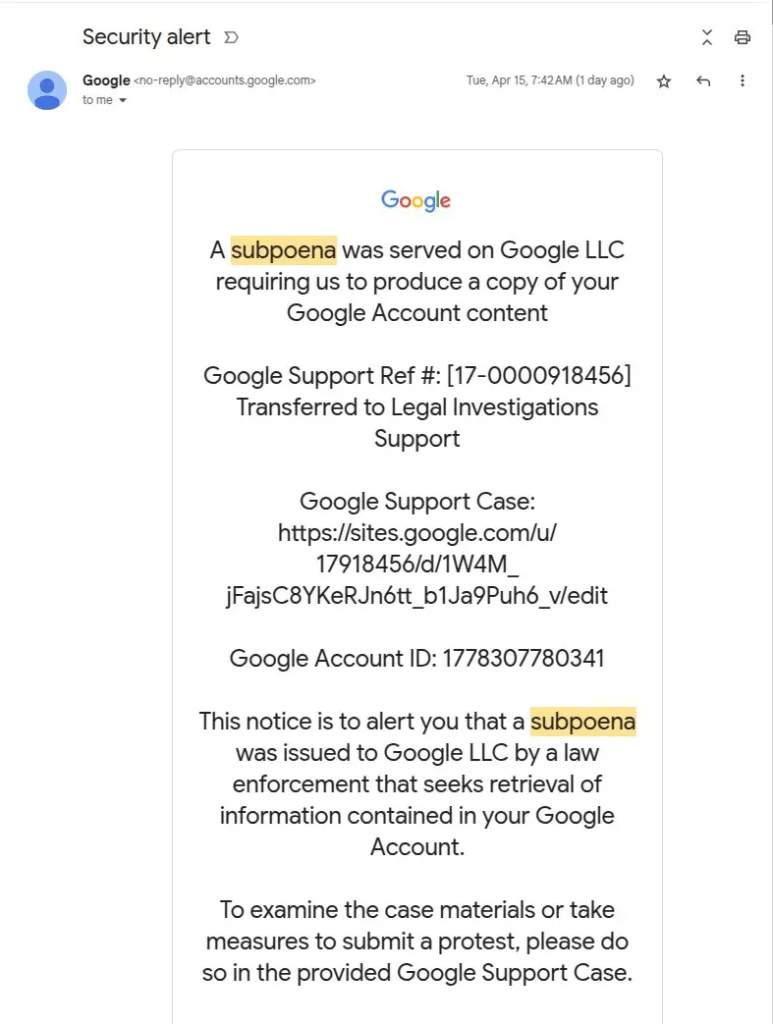

Pour ce genre de position, Elston s’est retrouvé dans le collimateur du commissaire australien à la sécurité électronique .

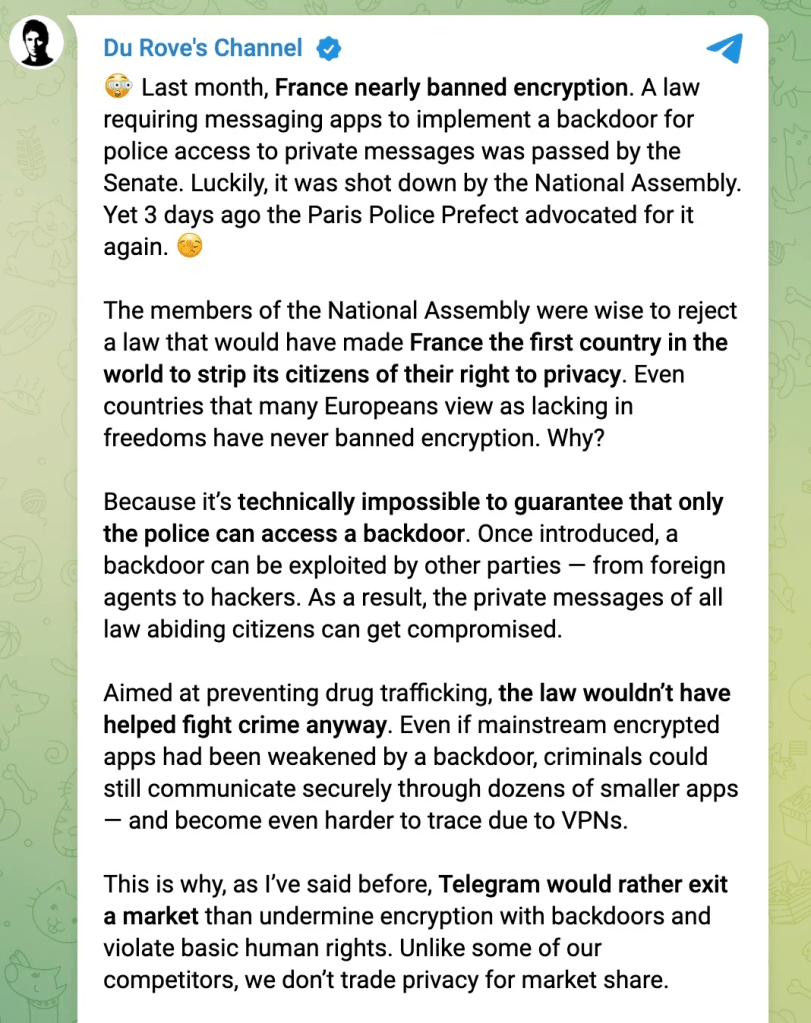

Quand Elston s’est adressé à X pour s’opposer à la nomination par l’Organisation mondiale de la santé (OMS) d’un activiste transgenre au conseil consultatif sur la politique transgenre – et, peut-être pour aggraver les choses, a utilisé « le mauvais pronom » en faisant référence à l’Australien en question – le gouvernement australien a réussi à obtenir de X qu’il censure l’un de ses messages l’année dernière, d’une manière « géographiquement limitée » à l’Australie.

Mais c’était en 2024 – et la Maison Blanche actuelle n’est pas contente de tout cela.

« La censure porte atteinte à la démocratie, réprime les opposants politiques et dégrade la sécurité publique », a annoncé le Bureau du Département d’État, tout en citant le cas d’Elston comme un exemple de « coercition » contre les médias sociaux américains.

Elston, à juste titre, trouve cette tournure des événements « formidable » – d’un gouvernement américain qui, plus ou moins ouvertement ou tacitement, adoptait des politiques et des techniques similaires, à un nouveau gouvernement qui défend son droit à la liberté d’expression.

« C’est formidable que le Département d’État soutienne ce que nous savons tous être vrai : la liberté d’expression est un droit fondamental, essentiel à une société démocratique », a déclaré Elston dans sa réaction au communiqué de presse du Département d’État.

Elston, X, Alliance Defending Freedom (ADF) International et l’Australian Human Rights Law Alliance ont poursuivi le commissaire à la sécurité électronique en justice, le résultat de la contestation judiciaire étant attendu plus tard en 2025.

D’autres personnes que le Département d’État a choisi de nommer et de faire honte maintenant en tant que pourvoyeurs internationaux « distingués » de censure sont l’ancien commissaire européen Thierry Breton (toujours en lien avec la pression exercée sur X), ainsi que les autorités turques (qui ont attaqué Meta).

La déclaration souligne que, même si le contenu peut être « répréhensible », cela ne justifie pas la censure, qui en fin de compte « porte atteinte à la démocratie, réprime les opposants politiques et dégrade la sécurité publique ».

Le Département d’État a souligné que la diplomatie américaine « continuera à mettre l’accent sur la promotion des libertés fondamentales ».

Voir l’article original cliquez ci-dessous :