Occultisme et mondialisme

La matrice du contrôle s’approfondit de jour en jour, mais l’éveil aussi. La question est : qu’est-ce qui se propage le plus vite : la programmation ou la prise de conscience ? Notre avenir en tant qu’espèce pourrait dépendre de la réponse.

En 2019 , lorsque Avril Haines, directrice du renseignement national, a annoncé, lors de l’exercice pandémique Event 201 , qu’ils allaient « inonder la zone de sources fiables », peu de gens ont compris cet aperçu d’un contrôle narratif coordonné. En quelques mois, nous avons pu le voir se dérouler en temps réel : messages unifiés sur toutes les plateformes, suppression de la dissidence et contrôle narratif coordonné qui a trompé une grande partie du monde.

Mais tout le monde n’a pas été dupé éternellement. Certains ont immédiatement compris le problème et ont remis en question tous les aspects du système dès le premier jour. D’autres ont pensé qu’il s’agissait simplement d’un gouvernement incompétent qui essayait de nous protéger. Beaucoup ont d’abord accepté le principe de précaution – mieux vaut prévenir que guérir. Mais à mesure que chaque échec politique pointait dans la même direction – vers plus de contrôle et moins d’intervention humaine –, il est devenu impossible d’ignorer ce schéma. Quiconque n’était pas complètement absorbé par le système a dû finalement faire face à son véritable objectif : non pas protéger la santé ou la sécurité, mais étendre le contrôle.

Une fois que vous avez identifié ce modèle de tromperie, deux questions devraient immédiatement surgir chaque fois que des sujets importants font la une des journaux : « Sur quoi mentent-ils ? » et « De quoi nous détournent-ils ? » Le modèle de tromperie coordonnée devient indéniable. Songez à la façon dont les médias ont passé trois ans à promouvoir les conspirations du Russiagate, provoquant une division sociale sans précédent tout en jetant les bases de ce qui allait devenir la plus grande opération psychologique de l’histoire. Aujourd’hui, alors que les médias nous inondent de reportages sur l’Ukraine, BlackRock se positionne pour tirer profit à la fois de la destruction et de la reconstruction. Le modèle devient indéniable une fois que vous l’avez vu : des crises fabriquées qui entraînent des « solutions » pré-planifiées qui élargissent toujours le contrôle institutionnel.

Les médias traditionnels fonctionnent sur la base d’une double tromperie : la désinformation et la manipulation. Les mêmes présentateurs qui nous ont vendu des armes de destruction massive en Irak, qui ont promu la « collusion russe » et qui ont insisté sur le fait que l’ordinateur portable de Hunter Biden était une « désinformation russe » occupent toujours les créneaux horaires de grande écoute. Tout comme nous le voyons avec la nomination de RFK Jr. au HHS, le schéma est cohérent : des attaques coordonnées remplacent le débat de fond , des points de discussion identiques apparaissent sur tous les réseaux et des questions légitimes sont écartées par la diffamation plutôt que par des preuves. Se tromper systématiquement n’est pas un défaut, c’est une caractéristique. Leur rôle n’est pas d’informer mais de fabriquer le consentement.

Le modèle est cohérent : saturer les médias de spectacles émotionnels tout en faisant avancer les programmes institutionnels avec un minimum de contrôle. Comme apprendre à repérer un faux sourire ou à entendre une fausse note dans la musique, vous développez un instinct pour le timing :

Argent et pouvoir :

- Alors que les médias se focalisent sur le 6 janvier, BlackRock et Vanguard resserrent discrètement leur emprise sur le marché immobilier résidentiel

- Alors que la couverture médiatique était obsédée par l’interdiction de Twitter de Trump, le Congrès a adopté le plus grand transfert de richesse vers le haut sous couvert de « l’aide Covid »

- Alors que des reportages haletants suivaient chaque mouvement du procès de Johnny Depp, la Fed imprimait plus d’argent que durant tout le siècle précédent

- Alors que les médias nous inondaient de reportages sur l’Ukraine, des restrictions sans précédent sur la production d’énergie ont remodelé l’économie mondiale

- Alors que les journalistes suivaient avec enthousiasme les inculpations de Trump, les banques centrales accéléraient leurs projets de monnaie numérique programmable

Contrôle médical :

- Alors que les médias se concentraient sur la promotion du vaccin par les célébrités, un nombre sans précédent de jeunes athlètes se sont effondrés sur le terrain

- Alors que les chaînes de télévision couvraient en long et en large les fusillades dans les écoles, des documents ont révélé que Pfizer était au courant de centaines d’effets secondaires

- Alors que la couverture médiatique se focalisait sur la « désinformation » anti-vaccin, les données des assurances ont montré des taux de mortalité excessifs alarmants

Contrôle numérique :

- Alors que les médias étaient obsédés par la modération du contenu de Twitter, l’infrastructure d’identité numérique était discrètement construite dans le monde entier

- Alors que la couverture médiatique se concentrait sur les problèmes de confidentialité de TikTok, les banques centrales ont accéléré le développement de la monnaie numérique

- Alors que les débats sans fin sur les chatbots IA dominaient les gros titres, les systèmes de surveillance biométrique se développaient à l’échelle mondiale

À mesure que ces tromperies deviennent plus évidentes, différentes formes de résistance émergent. La recherche de la vérité prend différentes formes. Certains deviennent de grands experts dans des tromperies spécifiques : ils documentent les succès précoces des traitements avec des médicaments réutilisés , découvrent les échecs des protocoles hospitaliers ou explorent l’impact des blessures causées par les vaccins . D’autres développent une perspective plus large pour voir comment les récits eux-mêmes sont conçus.

La brillante capacité de Walter Kirn à reconnaître les modèles nous plonge au cœur de notre réalité artificielle. Ses tweets qui décortiquent la couverture du meurtre du PDG de United montrent comment même les crimes violents sont désormais présentés comme des spectacles de divertissement , avec des arcs narratifs et des rebondissements narratifs . L’analyse de Kirn met en lumière une dimension essentielle du contrôle des médias : en transformant chaque crise en un récit de divertissement, ils détournent l’attention de questions plus profondes. Au lieu de se demander pourquoi les garde-fous institutionnels échouent ou qui en profite, le public est captivé par une indignation soigneusement scénarisée. Cette diversion délibérée garantit que les programmes institutionnels avancent sans examen.

Sa vision révèle comment les emballages de divertissement servent un système de contrôle plus vaste. Si chaque enquête requiert sa propre expertise, ce modèle de manipulation narrative se connecte à un réseau de tromperie plus vaste. Comme je l’ai exploré dans « The Information Factory » et « Engineering Reality », tout, de l’éducation à la médecine en passant par la monnaie elle-même, a été capturé par des systèmes conçus pour façonner non seulement nos choix, mais aussi notre perception même de la réalité.

Le plus révélateur est ce qu’ils ne cachent pas. Remarquez la rapidité avec laquelle les histoires disparaissent lorsqu’elles menacent les intérêts institutionnels. Vous souvenez-vous de la liste des clients d’Epstein ? De l’accaparement des terres de Maui ? Des blessures de plus en plus nombreuses causées par les vaccins ? Le silence en dit long.

Prenons l’exemple des récents témoignages de lanceurs d’alerte qui ont révélé des inquiétudes de sécurité occultées chez Boeing, une entreprise depuis longtemps impliquée dans des affaires avec des organismes de réglementation et des contrats gouvernementaux. Deux lanceurs d’alerte – tous deux d’anciens employés qui avaient donné l’alerte sur des problèmes de sécurité – sont morts dans des circonstances suspectes. La couverture médiatique de leur mort a disparu presque du jour au lendemain, malgré les profondes implications pour la sécurité publique et la responsabilité des entreprises. Ce schéma se répète dans d’innombrables cas où la responsabilité perturberait des structures de pouvoir bien ancrées, laissant des questions cruciales sans réponse et des récits étroitement contrôlés.

Ces décisions ne sont pas accidentelles : elles résultent de la propriété des médias, de l’influence des annonceurs et de la pression gouvernementale, garantissant que le récit reste étroitement contrôlé.

Mais ce qui est peut-être le plus frappant n’est pas la tromperie des médias en elle-même, mais la façon dont ils façonnent la réalité de leurs consommateurs. Observez avec quelle assurance ils répètent des phrases clairement conçues par des groupes de réflexion. Écoutez-les répéter comme des perroquets avec une conviction religieuse : « Le 6 janvier a été pire que le 11 septembre », « Faites confiance à la science », « La démocratie est sur le bulletin de vote » et, peut-être le mensonge le plus lourd de conséquences de l’histoire moderne, « Sûr et efficace ».

La classe des cadres et des professionnels se révèle particulièrement sensible à cette programmation . Leur expertise devient une prison de statut : plus ils investissent dans l’approbation institutionnelle, plus ils défendent avec ferveur les discours institutionnels. Observez la rapidité avec laquelle un médecin qui remet en question la sécurité des vaccins perd son permis d’exercer, la rapidité avec laquelle un professeur qui remet en question l’idéologie du genre fait l’objet d’un contrôle, la rapidité avec laquelle un journaliste qui dépasse les bornes se retrouve sur la liste noire.

Le système garantit la conformité par le biais de la capture économique : votre prêt hypothécaire devient votre laisse, votre statut professionnel votre gardien de prison. Les mêmes avocats qui se targuent de leur esprit critique réprimeront agressivement toute remise en question des récits officiels. Le professeur qui enseigne à « remettre en question les structures du pouvoir » devient apoplectique lorsque ses étudiants remettent en question les sociétés pharmaceutiques.

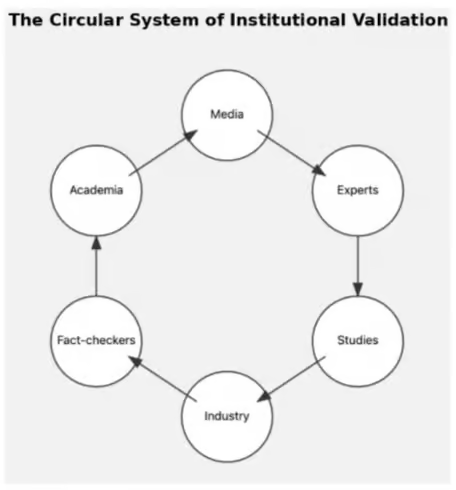

La validation circulaire rend la programmation presque impénétrable :

- Les médias citent des « experts »

- Les experts citent des études évaluées par des pairs

- Les études sont financées par l’industrie

- L’industrie façonne la couverture médiatique

- Les « vérificateurs de faits » citent le consensus médiatique

- L’université applique les conclusions approuvées

Ce système auto-renforçant forme une boucle fermée parfaite :

Chaque élément valide les autres tout en excluant les informations extérieures. Essayez de trouver le point d’entrée de la vérité dans ce système fermé. La fierté des professionnels pour leur esprit critique devient ironiquement sombre : ils ont simplement confié leurs opinions à des « sources faisant autorité ».

Le plus troublant est la façon dont ils ont volontiers renoncé à leur souveraineté. Regardez-les s’y soumettre :

- « Je suis la science » (traduction : j’attends des conclusions approuvées)

- « Selon les experts » (traduction : je ne pense pas par moi-même)

- « Les vérificateurs de faits disent » (traduction : je laisse les autres déterminer la vérité)

- « Le consensus est » (traduction : je m’aligne sur le pouvoir)

Leur empathie devient une arme utilisée contre eux. Vous remettez en question le confinement ? Vous tuez grand-mère. Vous doutez de la chirurgie de transition pour les mineurs ? Vous provoquez des suicides. Vous résistez aux initiatives d’équité ? Vous perpétuez l’oppression. La programmation fonctionne en faisant en sorte que la résistance soit ressentie comme de la cruauté.

Quelque chose de remarquable se produit sous le bruit de surface : un véritable réveil qui défie les frontières politiques traditionnelles. On le voit dans les échanges subtils entre collègues lorsque les récits officiels mettent à mal la crédibilité. Dans le silence croissant lors des dîners lorsque les arguments de propagande tombent à plat. Dans les regards complices entre inconnus lorsque le théâtre de santé publique atteint de nouveaux sommets d’absurdité.

Il ne s’agit pas d’un mouvement au sens traditionnel du terme – et cela ne peut pas l’être, car les structures traditionnelles des mouvements sont vulnérables à l’infiltration, à la subversion et à la capture. Il s’agit plutôt d’une émergence spontanée de la reconnaissance de modèles. Un réveil distribué sans direction centrale ni organisation formelle. Ceux qui voient au-delà des modèles reconnaissent la formation de masse pour ce qu’elle est, tandis que ses sujets projettent leur propre programmation sur les autres, rejetant la reconnaissance de modèles comme des « théories du complot », « anti-science » ou d’autres étiquettes réflexives destinées à empêcher un examen authentique.

La vérité la plus dure à affronter n’est pas de reconnaître la programmation, mais de faire face à ce que cela signifie pour la conscience humaine et la société elle-même. Nous observons en temps réel des preuves montrant que la plupart des esprits humains peuvent être capturés et redirigés par des opérations psychologiques sophistiquées. Leurs pensées ne leur appartiennent pas, et pourtant ils mourraient pour défendre ce qu’ils ont été programmés à croire.

Il ne s’agit plus seulement d’une critique des médias, mais d’une question existentielle sur la conscience humaine et le libre arbitre. Que signifie le fait que la capacité d’une espèce à penser de manière indépendante puisse être si complètement détournée ? Que signifie le fait que l’empathie naturelle et les instincts moraux deviennent des armes de contrôle ? Que l’éducation et l’expertise réduisent réellement la résistance à la programmation ?

La programmation fonctionne parce qu’elle détourne les motivations humaines fondamentales :

- Le besoin d’acceptation sociale (par exemple, le port du masque comme symbole visible de conformité)

- Le désir d’être perçu comme bon/moral (par exemple, adopter des positions performatives sur des questions sociales sans compréhension plus approfondie)

- L’instinct de faire confiance à l’autorité (par exemple, la confiance dans les responsables de la santé publique malgré les revirements politiques répétés)

- La peur de l’ostracisme (par exemple, éviter la dissidence pour maintenir l’harmonie sociale)

- Le confort du conformisme (par exemple, répéter des récits pour éviter la dissonance cognitive)

- La dépendance au statut (par exemple, signaler sa conformité pour maintenir son statut professionnel ou social)

Chaque trait naturel de l’être humain devient une vulnérabilité à exploiter. Les plus instruits deviennent les plus programmables car leur addiction au statut est plus profonde. Leur « pensée critique » devient un script exécuté sur du matériel corrompu.

C’est là le principal défi de notre époque : la conscience humaine peut-elle évoluer plus vite que les systèmes conçus pour la détourner ? La reconnaissance des modèles et la prise de conscience peuvent-elles se propager plus vite que le consensus fabriqué ? Un nombre suffisant de personnes peuvent-elles apprendre à lire entre les mensonges avant que la programmation ne soit achevée ?

Les enjeux ne pourraient être plus importants. Il ne s’agit pas seulement de politique ou d’éducation aux médias, mais de l’avenir de la conscience humaine elle-même. La capacité de notre espèce à penser de manière indépendante dépendra peut-être de ceux qui peuvent encore y accéder et qui aideront les autres à se libérer de ce sort.

La matrice du contrôle s’approfondit de jour en jour, mais l’éveil aussi. La question est : qu’est-ce qui se propage le plus vite : la programmation ou la prise de conscience ? Notre avenir en tant qu’espèce pourrait dépendre de la réponse.

Voir l’article original cliquez ci-dessous :